这几天,中国人工智能初创公司DeepSeek火了,不仅在美区下载榜上超越了ChatGPT,还引发多个美国科技股的股价暴跌。美国总统特朗普称DeepSeek的出现“给美国相关产业敲响了警钟”。为何DeepSeek的出现会让美国如此关注,甚至有些紧张?谭主联合中国工业互联网研究院独家揭秘背后的原因。

原因一:

高性价比冲击美国大模型垄断地位

DeepSeek可谓是用最少的钱,干最多的事。其推出的模型,在性能上和世界目前顶尖的GPT-4o等大模型不相上下。但在成本上,OpenAI训练ChatGPT-4花费的成本高达7800万美元,还可能达到1亿美元。而DeepSeek大模型训练成本不到600万美元,仅为同性能模型的5%到10%。新模型训练方法大幅度降低了大模型行业的入局门槛,大规模预训练不再是科技巨头的专利。在模型推理层面,DeepSeek新推出的DeepSeek-R1,价格为2.2美元/百万词元,而同性能OpenAI-o1的价格为60美元/百万词元,DeepSeek大概是OpenAI的三十分之一。这种“低成本”标志着推理大模型调用进入平价时代,显著改善了大模型的应用成本,对大模型在科研、企业等智力密集型产业中的应用具有重大的价值。因此,无论是从基础研究角度还是从商业层面上看,在训练和推理方面,对此前美国一些大模型公司的既有模式冲击比较大。

原因二:

模式创新,带来美国高新技术人员恐慌

DeepSeek开发成本与美国大模型相比大幅降低,在于应用了不同的模型训练模式,打破了美国堆砌算力的“豪气”方式。在喂养学习数据这一大模型重要环节上,OpenAI选择了“人海战术”,堆砌算卡、将资源集中在算力,用海量数据投喂实现能力的提升。而DeepSeek相比于“砸资源”选择了另外一种方式。利用算法把数据进行总结和分类,经过选择性处理之后再输送给大模型,最大优化算力实现了成本的降低和模型性能提升。目前看Meta耗费了大量资金训练Llama,但是效果上却没有成本极低的DeepSeek效果好,Meta高层已经在思考其员工是否在浪费公司资金,而这也引发了不少企业技术人员的恐慌,他们担心自己被质疑技术能力和创新性从而失去工作。根据海外互联网平台对DeepSeek的讨论分析,社交媒体帖子的数量远高于新闻报道,数量约是新闻报道的十倍。时间上来看,社交媒体帖子的讨论早于新闻报道,发酵起点比新闻媒体早了五天,这是由从事科技工作的自媒体人以及员工圈层传播“破圈”造成。

原因三:

国产大模型正在厚积薄发

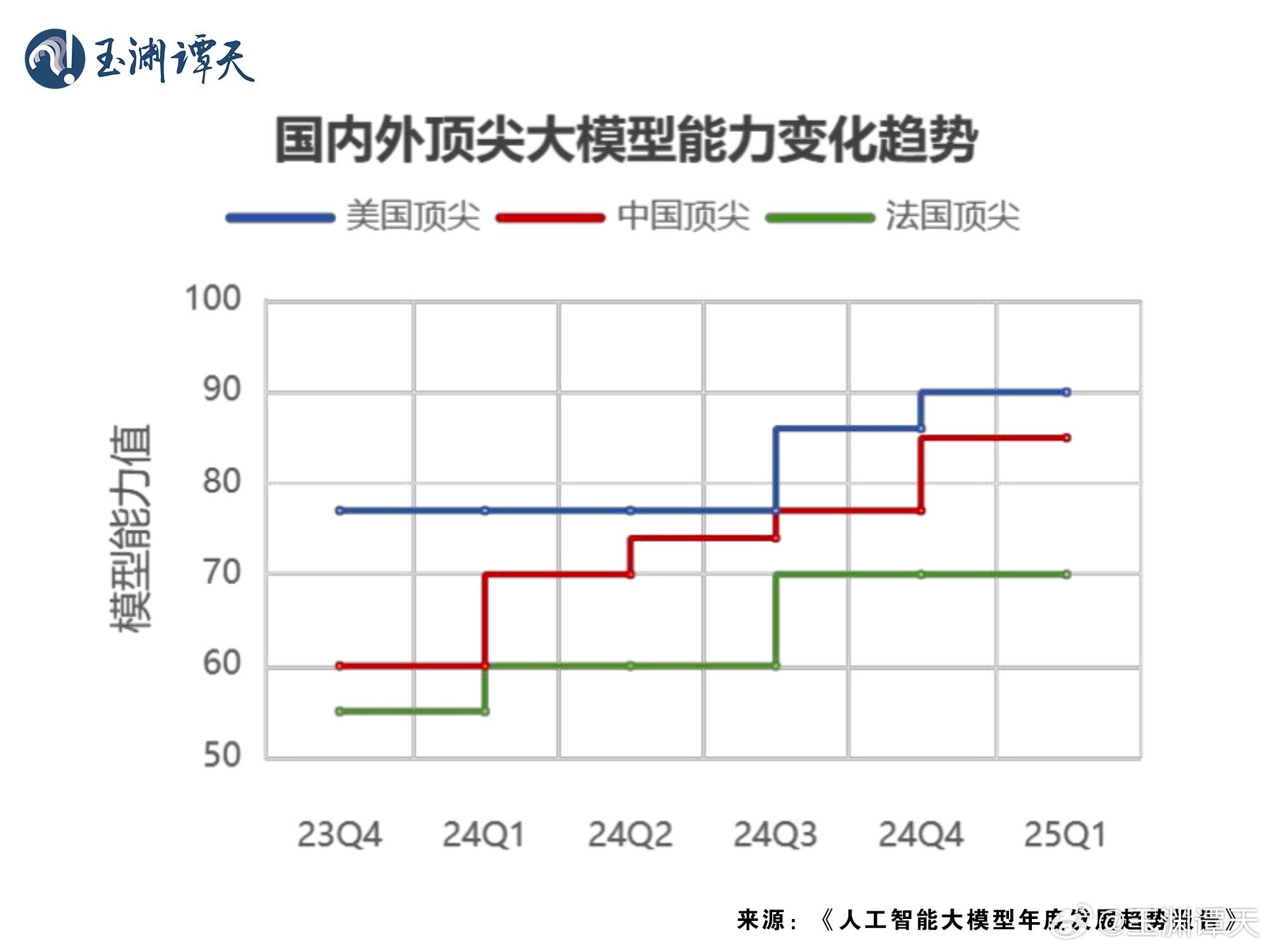

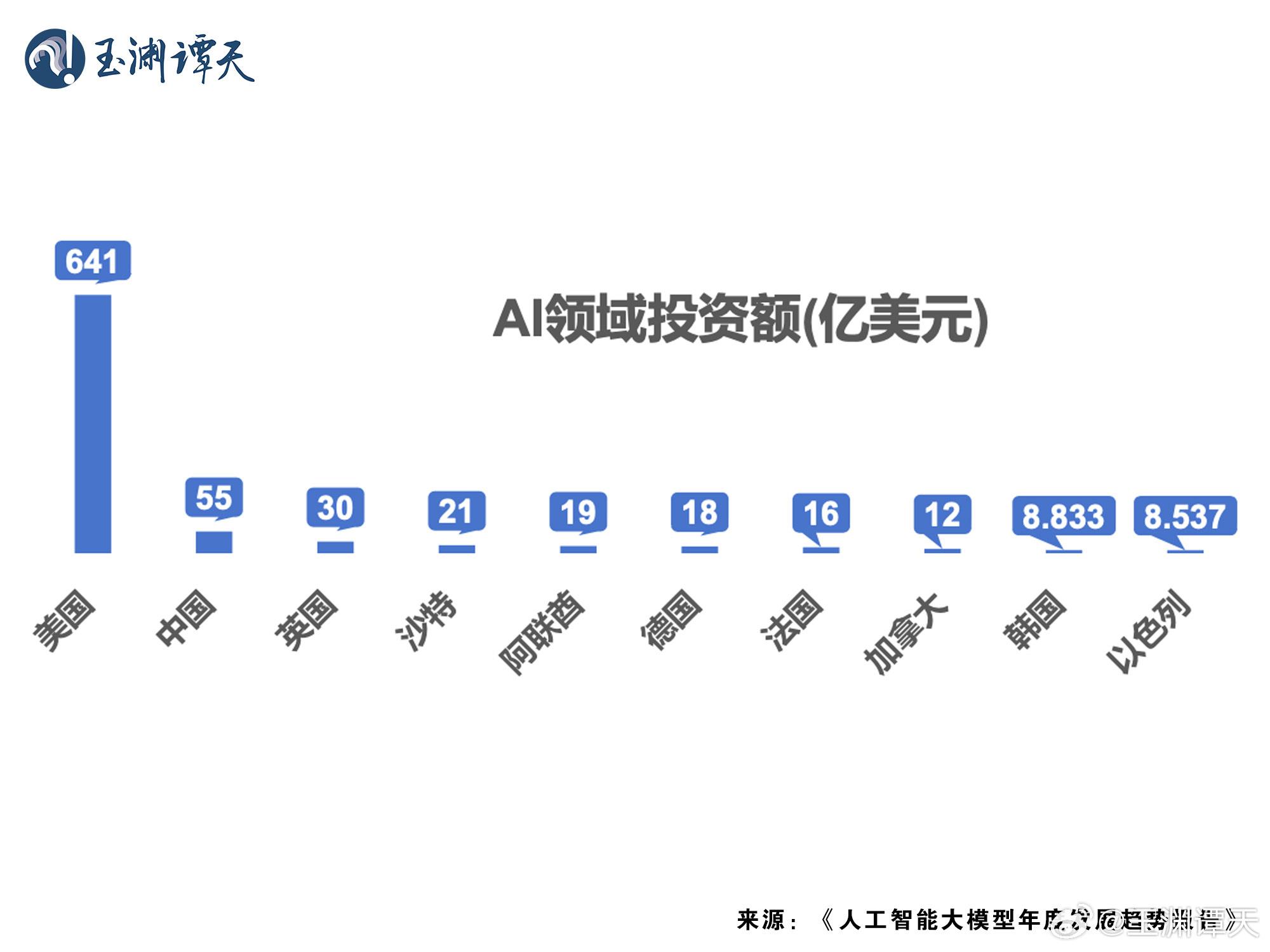

根据中国工业互联网研究院推出的《人工智能大模型年度发展趋势报告》,与国际顶尖大模型能力相比,2024年国内大模型的能力进步非常显著。从2023年第四季度到2025年第一季度的测评显示,国内外大模型能力差距缩小了将近75%。可以看出,DeepSeek的出现并不是所谓的“异军突起”,而是中国国内大模型整体发展的阶段性成果体现。此外,在报告统计的世界AI领域的投资上,中国55亿美元的投资额排在第二位,仅是第一位美国641亿投资额的不到十一分之一,中国未来在AI领域的发展上还有很大的空间。

如今,在DeepSeek对全球AI圈带来的震动下,很多业内人士都喊出了“DeepSeek接班OpenAI”的口号。事实上,DeepSeek的出现,并不是要取代别人,而是提出了更多样化的方案,打破了国际主流大模型的市场垄断,在大模型的发展道路上提出了不同于美西方的中国解法,让世界看到了在大模型领域不是只有拼算力这一条路,再一次向世界证明,什么是中国智慧。

还没有评论,来说两句吧...